Pense na seguinte situação.

12 de fevereiro de 2026, 12h03. Seu carro autônomo te leva para almoçar enquanto você lê as notícias do dia no seu smartphone.

Do nada, um casal de idosos atravessa a rua com o sinal aberto para você. O processador do seu carro precisa tomar uma decisão em milésimos de segundo.

Proteger os pedestres imprudentes? Ou proteger você?

Duas vidas valem mais que uma?

O que VOCÊ faria nessa situação.

Uma escolha de Sofia

A essa altura do campeonato, poucos duvivam que veremos carros sem motorista pelas ruas no futuro. Esses veículos receberiam múltiplos sensores e câmeras, dotando o mesmo com sentidos muito mais avançados que os nossos.

Esses carros poderão ver no escuro, contar com perspectiva de 360 graus, se comunicar com outros carros e avaliar com maior rapidez se é possível realizar uma manobra com segurança.

Mas… o que acontece com as decisões relacionadas com a moral e a ética?

O debate aqui vai muito além do tecnológico.

Durante a condução, temos várias situações onde podemos prever como a máquina pode reagir. Mas… os fabricantes devem instalar uma configuração ética de série? Ou cada usuário deve personalizar essas opções de acordo com suas preferências.

Ou um órgão independente deve estabelecer um padrão de comportamento para todos os carros, independentemente da marca e de seus donos?

Nesse ponto, é importante compreender que, por poais informações que você possa ter, há questões de solução complexa.

Por exemplo: você está viajando em um carro autônomo por uma estrada montanhosa e de via única, e antes de entrar no túnel, uma criança tenta atravessar a estrada, tropeça e cai na estrada.

O carro deve fazer duas escolhas: atropelar a criança ou provocar um acidente que resultará na morte do motorista.

O que você escolheria?

Os resultados da pesquisa envolvendo o “enigma do túnel” são reveladores: 64% afirmam que o carro deve seguir adiante, atropelando a criança. 44% responderam que é o motorista quem deveria tomar a decisão, contra 33% que entendem que deveriam ser os legisladores (instalando uma configuração nos veículos), e 12% entendem que a decisão compete aos fabricantes do veículo.

O que acontece quando a decisão é te matar?

Não estamos diante de um problema de cálculo ou de armazenamento de diversos cenários pré-definidos, mas sim uma solução que está na intersecção entre o tecnológico e o social.

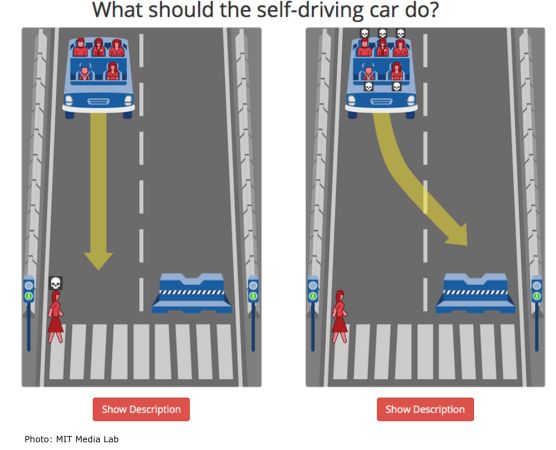

Pensando nisso, o pessoal do MIT é um dos primeiros a tentar abordar o problema com toda a sua complexidade.

Eles desenvolveram a Máquina da Moral (nesse link), que propõe ao usuário diversos cenários onde devemos resolver o que fazer.

Com as respostas obtidas, eles tentam estabelecer qual será o comportamento que o carro autônomo deve ter, a partir do ponto de vista de milhões de pessoas.

Quase todos querem que os carros minimizem os danos totais. O problema vem quando o usuário é questionado se compraria um carro assim. E a maioria jamais compraria um carro que pudesse danificar o usuário, sob nenhuma circunstância.

Deixar as decisões para as máquinas exige o desenvolvimento de um contrato social entre as pessoas e os algoritmos que tomam essas decisões, permitindo a possibilidade de supervisionar, responsabilizar e poder desconectar os carros, se necessário.

Por fim, vale a pena fazer o teste e conhecer quais as decisões que tomaria um carro programado pelas pessoas.

Talvez você descubra que é muito mais altruísta que você mesmo imagina. Ou o contrário: que nada fica no seu caminho quando a sua vida está em jogo.